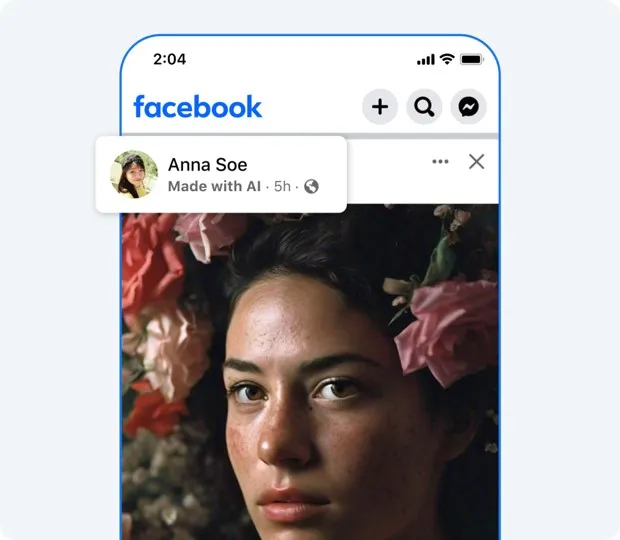

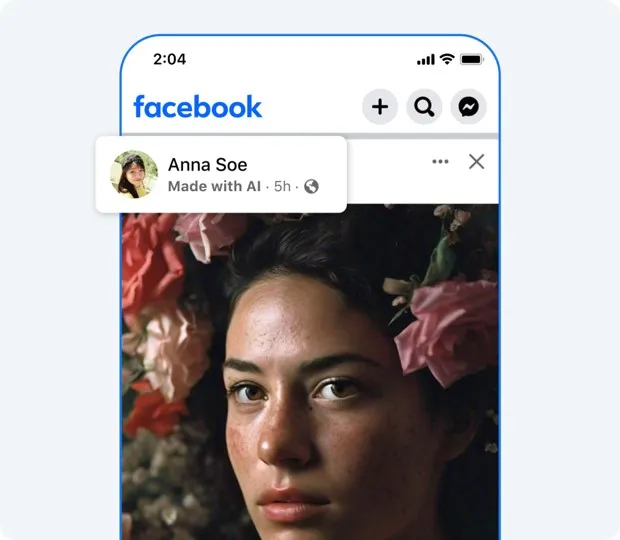

Fotógrafos reclamam que fotos reais, apenas com pequenos ajustes, estão sendo marcadas o selo usado pela Meta em Instagram, Facebook e Threads para identificar o uso de inteligência artificial. Metadados inseridos por ferramentas de edição da Adobe podem ser os “culpados”.

Os depoimentos dos fotógrafos estão em uma reportagem do site TechCrunch. Pete Souza, ex-fotógrafo da Casa Branca, teve um de seus cliques marcados com o rótulo. Ele suspeita que a Adobe está envolvida no problema: segundo Souza, a empresa mudou como a ferramenta de recorte funciona, que agora exige que a imagem seja “achatada” antes de salvá-la como JPEG.

Outro exemplo foi do time de críquete Kolkata Knight Riders. A foto dos jogadores comemorando o troféu do campeonato indiano foi marcada como se tivesse sido feita com IA, mesmo sendo real.

O site PetaPixelespecializado em fotografia, também traz alguns casos. O fotógrafo Peter Yan reclamou no Threads que sua imagem do Monte Fiji foi marcada como feita por IA, sendo que é um clique real. Ele diz ter usado o Photoshop apenas para “limpar alguns detalhes” — no caso, remover uma lixeira. O problema pode estar aí.

Postado por @yantastic

Ver sem tópicos

Ferramenta para remover objeto usa IA

Nos testes feitos pelo PetaPixelao usar as ferramentas pincel de recuperação, preenchimento sensível a conteúdo e carimbo de clonagem, a imagem não é marcada pela Meta como IA. Ao usar o preenchimento generativo, porém, a imagem é marcada como feita com IA — de fato, a ferramenta usa a tecnologia para ocupar os espaços que ficariam em branco após a remoção de objetos.

Quando o selo para identificar o uso de inteligência artificial foi anunciado, em fevereiro de 2024, a Meta disse que usaria informações presentes nos padrões técnicos C2PA e IPTC para identificar imagens geradas por IA. A Adobe é cofundadora do C2PA e usa os padrões da aliança nos metadados dos arquivos.

Após a publicação da matéria do TechCruncha Meta declarou que está “levando em consideração feedbacks recentes e continua a avaliar a abordagem para que as etiquetas reflitam a quantidade de IA usada em uma imagem”.

A empresa também afirmou estar conversando com desenvolvedoras de apps que usam IA para entender formas melhores de aplicar os rótulos. De fato, uma foto do Monte Fuji em que uma lixeira foi removida e uma imagem do Papa usando jaqueta não parecem pertencer a uma mesma classificação.

O problema fica ainda pior ao considerar o atual estado do Facebook. Um estudo da Universidade de Stanford (Estados Unidos) identificou táticas de clickbait e golpes usando imagens geradas por IA, que se aproveitam de pessoas que não têm tanto conhecimento da tecnologia. Muitas dessas imagens não estão recebendo o rótulo.

Enquanto a solução não é aprimorada, o jeito é se proteger. Andrea Henderson, professora da Universidade do Mississippi (EUA), diz que é importante educar as pessoas para que elas entendam o que é a IA generativa.

O fotógrafo Dimitry Mak tem uma opinião parecida. “Cada indivíduo precisa buscar conhecimento e se informar para tomar decisões”, explica, em texto publicado no Medium. “A Meta pode dar diretrizes, mas o pensamento crítico de cada pessoa é o que vai determinar a eficácia dessas medidas.”

Com informações: TechCrunch, PetaPixel